Dopo un data scientist ha scelto un target variabile, ad esempio, la “colonna” in un foglio di calcolo che si desidera prevedere – e completato i prerequisiti di trasformazione di dati e la costruzione di un modello, di una delle fasi finali della valutazione di prestazioni del modello.

Confusion Matrix

La scelta di una metrica delle prestazioni spesso dipende dal problema aziendale da risolvere., Supponiamo che tu abbia 100 esempi nel tuo set di dati e che tu abbia inviato ciascuno al tuo modello e ricevuto una classificazione. La classificazione prevista rispetto a quella effettiva può essere tracciata in una tabella chiamata matrice di confusione.,0

| Negativo (predetto) | Positivo (predetto) | |

|---|---|---|

| Negativo (effettivo) | 98 | 0 |

| Positivo (effettivo) | 1 | 1 |

La tabella di cui sopra descrive un’uscita di negativo vs positivo. Questi due risultati sono le “classi” di ciascun esempio., Poiché esistono solo due classi, il modello utilizzato per generare la matrice di confusione può essere descritto come un classificatore binario. (Esempio di un classificatore binario: rilevamento di spam. Tutte le email sono spam o non spam, proprio come tutto il cibo è un hot dog o non un hot dog.)

Per interpretare meglio la tabella, puoi anche vederla in termini di veri positivi, veri negativi, falsi positivi e falsi negativi.,

| Negative (predicted) | Positive (predicted) | |

|---|---|---|

| Negative (actual) | true negative | false positive |

| Positive (actual) | false negative | true positive |

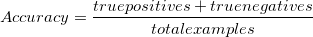

Accuracy

Overall, how often is our model correct?,

1

1

Come euristica, o regola empirica, la precisione può dirci immediatamente se un modello viene addestrato correttamente e come può funzionare in generale. Tuttavia, non fornisce informazioni dettagliate sulla sua applicazione al problema.

Il problema con l’utilizzo della precisione come metrica di prestazioni principale è che non funziona bene quando si ha un grave squilibrio di classe. Usiamo il set di dati nella matrice di confusione sopra. Diciamo che i negativi sono transazioni normali e i positivi sono transazioni fraudolente., La precisione ti dirà che hai ragione il 99% delle volte in tutte le classi.

Ma possiamo vedere che per la classe di frode (positiva), hai ragione solo il 50% delle volte, il che significa che perderai denaro. Diavolo, se hai creato una regola difficile che prevede che tutte le transazioni fossero normali, avresti ragione il 98% delle volte. Ma questo non sarebbe un modello molto intelligente, o una metrica di valutazione molto intelligente. Ecco perché, quando il tuo capo ti chiede di dire loro ” quanto è preciso quel modello?”, la tua risposta potrebbe essere: “È complicato.,”

Per dare una risposta migliore, dobbiamo conoscere i punteggi di precisione, richiamo e f1.

Scopri come applicare l’IA alle simulazioni ”

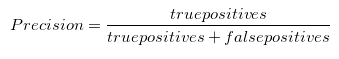

Precision

Quando il modello prevede positivo, quanto spesso è corretto?

La precisione aiuta quando i costi dei falsi positivi sono elevati. Quindi supponiamo che il problema implichi la rilevazione del cancro della pelle. Se abbiamo un modello che ha una precisione molto bassa, a molti pazienti verrà detto che hanno il melanoma, e questo includerà alcune diagnosi errate. Un sacco di test extra e lo stress sono in gioco., Quando i falsi positivi sono troppo alti, coloro che monitorano i risultati impareranno a ignorarli dopo essere stati bombardati da falsi allarmi.

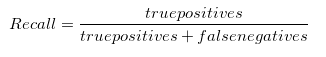

Recall

Recall aiuta quando il costo dei falsi negativi è elevato. E se dovessimo rilevare i missili nucleari in arrivo? Un falso negativo ha conseguenze devastanti. Se sbagli, moriremo tutti. Quando i falsi negativi sono frequenti, vieni colpito dalla cosa che vuoi evitare. Un falso negativo è quando decidi di ignorare il suono di un ramoscello che si rompe in una foresta oscura e vieni mangiato da un orso., (Un falso positivo sta rimanendo sveglio tutta la notte insonne nella tua tenda in un sudore freddo ascoltando ogni shuffle nella foresta, solo per rendersi conto la mattina dopo che quei suoni sono stati fatti da uno scoiattolo. Non e ‘ divertente.) Se tu avessi un modello che lascia entrare missili nucleari per errore, vorresti buttarlo fuori. Se tu avessi un modello che ti ha tenuto sveglio tutta la notte perché scoiattoli, si vorrebbe buttare fuori, pure., Se, come la maggior parte delle persone, preferisci non essere mangiato dall’orso, e anche non stare sveglio tutta la notte preoccupato per gli allarmi chipmunk, allora devi ottimizzare per una metrica di valutazione che sia una misura combinata di precisione e richiamo. Inserisci il punteggio F1

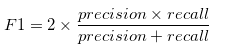

Punteggio F1

F1 è una misura complessiva dell’accuratezza di un modello che combina precisione e richiamo, in quel modo strano che l’aggiunta e la moltiplicazione mescolano solo due ingredienti per creare un piatto separato del tutto., Cioè, un buon punteggio F1 significa che hai bassi falsi positivi e bassi falsi negativi, quindi stai identificando correttamente le minacce reali e non sei disturbato da falsi allarmi. Un punteggio F1 è considerato perfetto quando è 1, mentre il modello è un errore totale quando è 0.

Ricorda: tutti i modelli sono sbagliati, ma alcuni sono utili. Cioè, tutti i modelli genereranno alcuni falsi negativi, alcuni falsi positivi e possibilmente entrambi., Mentre puoi sintonizzare un modello per minimizzare l’uno o l’altro, spesso affronti un compromesso, in cui una diminuzione dei falsi negativi porta ad un aumento dei falsi positivi o viceversa. Dovrai ottimizzare per le metriche delle prestazioni più utili per il tuo problema specifico.

Note a piè di pagina

0) “Matrice di confusione” deve essere uno dei termini più involontariamente poetici in tutta la matematica. È il tipo di frase che leggi e dici: “Vivo in una matrice di confusione. La matrice di confusione della modernità. Siamo flipper che rimbalzano tra falsi positivi e falsi negativi alla ricerca della verità.,”

1) Per una facile formattazione Latex che puoi screenshot e incorporare nei post del tuo blog, prova math.URL.,TMs